Ο CEO της Google προειδοποιεί: Η τεχνητή νοημοσύνη θέλει έλεγχο όπως τα πυρηνικά όπλα (vid)

Τις έντονες ανησυχίες του για την τεχνητή νοημοσύνη εκφράζει ο CEO της Google, Σούνταρ Πιτσάι, θεωρώντας πως θα χρειαστεί ένα παγκόσμιο ρυθμιστικό πλαίσιο, παρόμοιο με αυτό για τον έλεγχο των πυρηνικών όπλων.

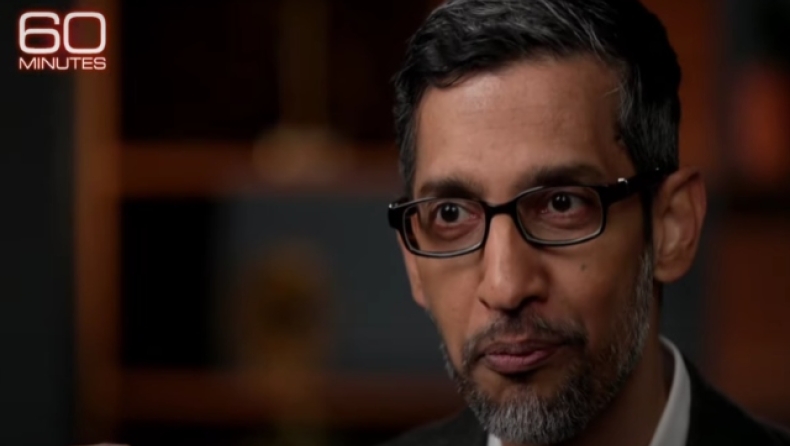

Σε συνέντευξή που παραχώρησε στην εκπομπή 60 minutes του CBS, ο Σούνταρ Πιτσάι είπε πως οι κυβερνήσεις θα πρέπει να καταστρώσουν ρυθμιστικά πλαίσια παράλληλα με την ανάπτυξη των συστημάτων τεχνητής νοημοσύνης, αποκαλύπτοντας πως αυτό το πρόβλημα τον κρατά ξύπνιο τα βράδια.

Ο Πιτσάι υπογραμμίζει ότι η τεχνητή νοημοσύνη θα μπορούσε να προκαλέσει προβλήματα, λόγω των δυνατοτήτων για παραπληροφόρηση. «Με την τεχνητή νοημοσύνη θα είναι εφικτό να δημιουργηθεί εύκολα ένα βίντεο, όπου θα μπορούσε να φαίνεται ένας δημοσιογράφος να λέει κάτι, ή εγώ να λέω κάτι, που ποτέ δεν είπαμε. Και θα μπορούσε να είναι αληθοφανές. Σε κοινωνική κλίμακα μπορεί να προκαλέσει μεγάλη ζημιά».

Ο επικεφαλής της Google υποστήριξε ότι η έκδοση της τεχνολογίας τεχνητής νοημοσύνης της που είναι διαθέσιμη στο κοινό μέσω του chatbot Bard, είναι ασφαλής. Πρόσθεσε ότι η Google συμπεριφέρεται υπεύθυνα, και δεν λανσάρει στο κοινό προηγμένες εκδόσεις του Bard, προκειμένου να δοκιμαστούν.

«Δεν καταλαβαίνουμε πλήρως ούτε το δικό μας σύστημα ΑΙ»

Στη συνέντευξη που παραχώρησε παραδέχτηκε πάντως και το γεγονός ότι η Google δεν κατανοούσε τον τρόπο που ανταποκρινόταν το δικό της σύστημα τεχνητής νοημοσύνης σε δοκιμασίες που του έθετε.

«Υπάρχει μια πτυχή αυτού του φαινομένου την οποία, όλοι εμείς στον τομέα, την αποκαλούμε «μαύρο κουτί». Δεν το καταλαβαίνουμε πλήρως. Και δεν μπορούμε να πούμε ακριβώς γιατί είπε κάτι ή γιατί έκανε κάποιο λάθος».

Ο Πιτσάι ακόμη τονίζει ότι η κοινωνία δεν φαίνεται να είναι έτοιμη για τις ραγδαίες εξελίξεις στην τεχνητή νοημοσύνη. «Φαίνεται να υπάρχει αναντιστοιχία» μεταξύ του ρυθμού με τον οποίο η κοινωνία σκέφτεται και προσαρμόζεται στις αλλαγές σε σύγκριση με τον ρυθμό με τον οποίο εξελίσσεται η τεχνητή νοημοσύνη. Ωστόσο, πρόσθεσε ότι «τουλάχιστον οι άνθρωποι έχουν αρχίσει να αντιλαμβάνονται τους πιθανούς κινδύνους της πιο γρήγορα».

Τέλος, επισήμανε ότι οι οικονομικές συνέπειες της τεχνητής νοημοσύνης θα είναι καθοριστικές και θα επηρεάσουν τα πάντα. «Κάθε προϊόν σε κάθε εταιρεία», όπως εξηγεί.

Αναφερόμενος, για παράδειγμα, στον κλάδο της ιατρικής, ο Πιτσάι είπε ότι σε πέντε έως 10 χρόνια από σήμερα, ένας ακτινολόγος θα μπορούσε να συνεργάζεται με έναν βοηθό Τεχνητής Νοημοσύνης, για την ιεράρχηση των περιστατικών. Ο ίδιος εκτιμά πως μεταξύ των επαγγελμάτων που θα επηρεαστούν είναι οι συγγραφείς, οι λογιστές, οι αρχιτέκτονες και οι προγραμματιστές.